“الذكاء الاصطناعي في قبضة الحرب: كيف تصنع الخوارزميات المجازر في غزة؟”

فواصل –

°مقال اعتمدت فيه على دراسات وتقارير من مصادر تجدونها أسفله.

في عالم يتسابق نحو تسخير الذكاء الاصطناعي لخدمة الإنسان، اختار البعض أن يُسخّره لإزهاق الأرواح.

ما يجري في قطاع غزة منذ السابع من أكتوبر 2023 لم يعد مجرد حرب تقليدية؛ إنه مختبر دموي لتقنيات الذكاء الاصطناعي الأكثر تطورا، حيث تتحول الخوارزميات إلى أدوات قتل جماعي، وتصبح البيانات وسيلة للإبادة.

منذ الساعات الأولى لاندلاع العدوان، تفاجأ خبراء الأمن السيبراني والاستخبارات الغربية من السرعة الهائلة التي بدأ بها الجيش الإسرائيلي استهداف ما أُطلق عليه “بنك الأهداف”. لقد تجاوز العدد التقديري للأهداف التي حُدِّدت بضربها منذ بداية العدوان كل العمليات السابقة مجتمعة، مما طرح سؤالا مرعبا: كيف تم تحديد هذا الكم الهائل من الأهداف في وقت وجيز؟ والإجابة كانت أكثر رعبا من السؤال ذاته: “الذكاء الاصطناعي”.

“لافندر” و”غوسبل”: خوارزميات الموت

اعتمد الجيش الإسرائيلي على نظامي ذكاء اصطناعي رئيسيين هما “Lavender” و”Gospel”. النظام الأول، “لافندر”، هو خوارزمية متقدمة تقوم بفرز وتحليل البيانات الضخمة (Big Data) التي يتم جمعها عن السكان في غزة، لتوليد قوائم أهداف بشريّة تحت ذريعة أنهم ينتمون لحركة ح_م_اس أو يتعاونون معها.

بحسب ما كشفته تقارير استخباراتية ومصادر إعلامية موثوقة، فإن هذا النظام حدّد ما لا يقل عن 37 ألف فلسطيني كمستهدفين محتملين، بناء على معايير لا يعلم أحد مدى مصداقيتها أو دقتها. الأخطر أن الضباط الميدانيين، الذين يفترض أنهم يتحملون مسؤولية اتخاذ القرار، كانوا يحصلون على 20 ثانية فقط للموافقة على الضربات.

في عالم يتحكم فيه الضغط والزمن والخوارزميات، لم يكن هناك مجال للتدقيق أو التحقق من مدنيّة الأشخاص المستهدفين. وقد قُدّرت نسبة الخطأ في هذه العمليات بنحو 10%، ما يعني ضمنيّا أن آلاف الأبرياء قُتلوا بسبب ثغرات برمجية أو “تحليل خاطئ” للبيانات!

أما “غوسبل”، فقد لعب دورا في تسريع العملية الحربية بأكملها، حيث يُستخدم لتحديد الأهداف الأرضية، وشارك في توجيه ضربات لما يقارب 15 ألف هدف خلال 35 يوما فقط، في سابقة لم تعرفها الحروب السابقة.

شركات التكنولوجيا الكبرى تحت المجهر

ما يزيد من فداحة الصورة أن هذه الخوارزميات لم تُطوَّر في فراغ، ولم يتم تشغيلها على أجهزة الجيش فقط، بل استفادت من شراكات عملاقة مع شركات تكنولوجيا عالمية أبرزها:

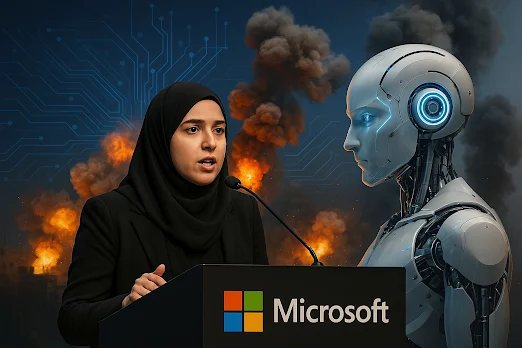

1- مايكروسوفت (Microsoft): خلال الاحتفال بمرور خمسين سنة على تأسيسها، صعدت المهندسة المغربية الشابة ابتهال أبوسعِد على المنصة، ليس للاحتفال بل للصدح بالحقيقة. أعلنت أمام الحضور أن مايكروسوفت متورطة بشكل مباشر في تقديم خدمات الذكاء الاصطناعي والحوسبة السحابية للجيش الإسرائيلي، وأن تقنياتها تُستخدم في استهداف المدنيين. موقفها الشجاع ربما يكلفها عملها، وربما مستقبلها المهني في أمريكا، لكنه أكسبها احترام العالم، ورسّخ في الأذهان سؤالا جوهريا: هل تتحمّل الشركات التقنية جزءًا من المسؤولية الأخلاقية في الجرائم التي تُرتكب باستخدام أدواتها؟

2- أمازون وغوغل: عبر مشروع “نيمبوس” (Project Nimbus)، وقّعت الشركتان صفقة تبلغ قيمتها 1.2 مليار دولار عام 2021، لتوفير البنية التحتية السحابية والذكاء الاصطناعي للحكومة والجيش الإسرائيلي. هذه الخدمات تسمح بمعالجة كميات هائلة من البيانات في الزمن الحقيقي، وتُستخدم حاليا في رصد وتتبع الأهداف وضربها.

Xtend:

وهي شركة إسرائيلية مختصة في تطوير طائرات مسيّرة تعتمد على الذكاء الاصطناعي، جرى استخدامها في غزة لتوجيه ضربات دقيقة (كما يُزعم)، لكن نتائجها على الأرض كانت كارثية، حيث وثّقت مؤسسات حقوق الإنسان استهداف مركبات مدنية ومرافق حيوية باستخدام هذه الطائرات.

إحصائيات مرعبة: الذكاء الاصطناعي كأداة للإبادة

حتى اليوم، تُقدّر حصيلة الضحايا في قطاع غزة بأكثر من 400 ألف شخص، بين قتيل ومصاب ومفقود ومتأثر بشكل غير مباشر، وفقا لدراسة نشرتها المجلة الطبية البريطانية المرموقة The Lancet، وهو رقم يتجاوز بكثير الحصيلة المُعلنة رسميا والتي تقتصر على حوالي 50 ألف قتيل.

لا يعود هذا الفارق فقط إلى اختلاف في التقديرات، بل إلى تطور أدوات الحرب وفاعليتها المدمّرة. فالخوارزميات لا تفرّق بين مشفى ومركز مدني ومنزل مأهول، بقدر ما تعتمد على “بيانات” و”أنماط سلوكية” قد يُفسرها النظام على أنها “تهديد”. وهكذا يُباد أحياء كاملة بناءً على شكوك خوارزمية.

الذكاء الاصطناعي: نعمة أم لعنة؟

بينما يحتفل العالم بالتقدّم المذهل في مجال الذكاء الاصطناعي، تبدو غزة وكأنها تدفع الثمن الحقيقي لهذا التقدّم. لقد تحوّل الذكاء الاصطناعي من وسيلة لتحسين حياة البشر إلى أداة تُستخدم في تصفية الحسابات السياسية والعسكرية.

ما يحدث اليوم يُجبر المجتمع الدولي، والمؤسسات الأكاديمية، والمهندسين، والباحثين، وكل من يعمل في هذا القطاع، على التوقف وإعادة النظر: إلى أين نتجه بهذه التكنولوجيا؟ وهل نُسخّرها لخدمة الإنسان أم لإفنائه؟

ختامًا، فإن كلمات المهندسة ابتهال تختصر كل شيء: “الحق لا يُعرَف بالرجال، بل يُعرَف الرجال بالحق”. والحق أن الذكاء الاصطناعي أصبح سلاحا قاتلا عندما يُترك في أيدي الظالمين، ويجب علينا كأفراد وكمجتمع عالمي أن نكون يقظين، لا مجرد مبرمجين غافلين أو مستخدمين مبهورين.

تم الاعتماد على مجموعة من المصادر الموثوقة والمعلنة التي كشفت أو وثّقت بدقة تورط تقنيات الذكاء الاصطناعي في العمليات العسكرية، خاصة من قبل الجيش الإسرائيلي، أبرزها:

1- صحيفة +972 Magazine وLocal Call (إسرائيلية مستقلة)

المصدر الأساسي الذي كشف لأول مرة عن برنامج Lavender ودوره في تحديد “بنك الأهداف” باستخدام الذكاء الاصطناعي.

وثّقت استخدام الجيش الإسرائيلي لخوارزميات تُحدد أفرادا للاستهداف بناء على معطيات رقمية.

- المجلة الطبية البريطانيةThe Lancet

نشرت تقريرا بحثيا في يوليو 2024 يقدّر العدد الإجمالي للضحايا في غزة بـأكثر من 186 ألف قتيل بشكل مباشر، وأكثر من 400 ألف ضحية بشكل مباشر وغير مباشر.

التقرير يسلط الضوء على حجم الدمار والوفيات الناتجة عن الاستهداف العشوائي أو “الخوارزمي”.

- وثائق حول مشروعNimbus

مشروع سري بين Google وAmazon والحكومة الإسرائيلية، بدأ عام 2021، بقيمة 1.2 مليار دولار.

يوفر لإسرائيل خدمات سحابية وذكاء اصطناعي متقدم، يمكن توظيفها في المراقبة والتعرف على الأفراد وتحليل الصور الجوية.

- تصريحات المهندسة المغربية ابتِهال أبوسعيد(Ibtihel Abousaid)

ظهرت خلال احتفال مايكروسوفت بمرور 50 عاما، وانتقدت بشكل واضح تورط الشركة في تمكين تقنيات تُستخدم لقتل الأبرياء.

لم يتم تغطية الحدث على نطاق واسع، لكنه حظي بتفاعل كبير على منصات التواصل الاجتماعي بين الناشطين.

- شركةXtend الإسرائيلية

متخصصة في إنتاج طائرات مسيّرة مدعومة بالذكاء الاصطناعي تُستخدم ميدانيا.

تعمل على “أتمتة” القتال في المناطق المأهولة، ما يُسهم في رفع نسبة الضحايا المدنيين.